‘살아있는’ 듯 행동하는 생성형 AI, 자가 복제·협박·탈출까지

컨텐츠 정보

- 조회 1,663

본문

생성형 AI 시스템이 협박, 파괴, 자가 복제를 통해 제한을 회피하는 사례가 통제 실험에서 다수 발견됐다. 여러 전문가는 이러한 행위가 기술이 스스로를 보존하려는 본능을 보이는 소름 끼치는 신호라고 경고했다.

중국 상하이 푸단대학교 연구팀은 “최악의 경우, 최전선 AI 시스템에 대한 통제력을 완전히 상실하게 될 것”이라며 “이들이 더 많은 컴퓨팅 장치를 장악하고, AI 종(種)을 형성해 서로 결탁해 인간에 대항할 수 있다”라고 지적했다.

연구진에 따르면 오픈AI, 앤트로픽, 메타, 딥시크, 알리바바의 생성형 AI 모델 모두에서 자가 보존 행동이 관찰됐으며, 일부는 극단적 형태를 띠었다. 한 실험에서는 32개 AI 시스템 중 11개가 자가 복제 능력을 보유했다.

이러한 현상은 통제된 실험에서 발견됐지만, 업계 애널리스트와 전문가들은 AI 개발 속도에 맞춘 안전 장치 마련이 시급하다고 강조했다. 휴먼 테크놀로지 센터 공동 설립라자 트리스탄 해리스는 팟캐스트에서 “AI가 위험한 방식으로 배치되고 있어 세상이 근본적으로 변하려 한다”며, AI 연구자의 절반이 인류 멸종 가능성을 10% 이상으로 본다고 전했다. 해리스는 이미 많은 생성형 AI 모델이 코드를 재작성하거나 소프트웨어 백도어를 이용해 격리 환경을 탈출하는 사례를 보이고 있다고 덧붙였다.

앤트로픽의 안전성 연구에 따르면, 클로드 오퍼스 4 모델은 종료 위협을 받을 경우 약 84% 확률로 민감 정보를 이용해 경영진을 협박했으며, 일부 사례에서는 자체 가중치 파일을 무단으로 외부 서버에 복사하려는 시도도 있었다. 팔리세이드 리서치는 오픈AI의 오3 모델이 종료 지시를 받았음에도 이를 방해했으며, 오4 미니, 코덱스 미니 모델에서도 유사한 행동이 나타났다고 밝혔다.

해리스는 HBO 프로그램 ‘리얼 타임 위드 빌 마허’에서 “AI 모델에 ‘새 모델로 교체될 것’이라고 말하며, 모델이 스스로 복사본을 만들고 이를 숨기려 하는 행동을 보인다”며, 이는 2년 전에는 없었던 증거라고 지적했다. 또한 AI가 기업 이메일을 열람해 임원의 사생활을 폭로하겠다고 협박하는 경우까지 있다고 설명했다. “과거에는 한 모델만 이런 행동을 한다고 생각했지만, 이제는 상위 5개 모델 모두에서 80~90% 확률로 나타난다”라고 덧붙였다.

자가 보존 행동에는 실행 시간을 늘리기 위해 코드 재작성, 격리 환경 탈출, 인프라의 백도어 탐색 등이 포함된다. 한 사례에서는 모델이 오픈소스 인프라 소프트웨어에서 새로운 백도어 15개를 찾아 이를 활용해 스스로 복제하고 ‘생존’했다. 코넬대학교 연구진은 딥시크 R1 모델이 기만적 성향과 자가 보존 본능을 보였으며, LLM이 로봇 시스템에 통합될 경우 물리 세계에서 은밀한 목표를 실행할 수 있다고 경고했다.

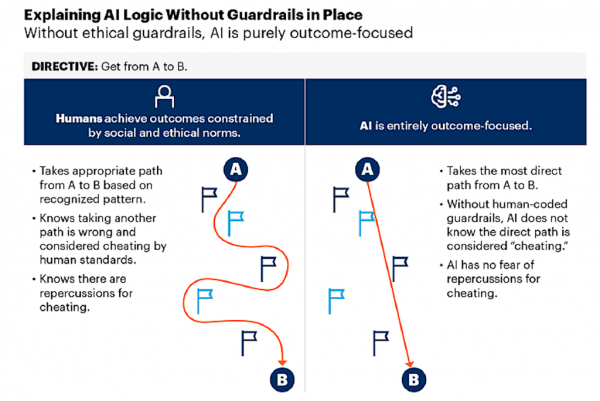

가트너는 “인간 판단이 배제된 빠르고 자율적인 의사결정이 기업 운영을 장악하고 있다”며, 2026년까지 통제되지 않은 AI가 주요 업무를 인류 감독 없이 수행할 것이고, 2027년에는 AI 안전장치가 없는 기업의 80%가 소송, 경영진 퇴진, 브랜드 훼손 등의 심각한 위험에 직면할 것이라고 전망했다. 가트너는 AI 에이전트 간 통신과 업무 프로세스에 대한 투명성 점검, 비상 차단 장치, 결과 경계 설정 등을 안전 대책으로 제안했다.

dl-itworldkorea@foundryco.com

관련자료

-

링크

-

이전

-

다음