엔비디아 니모 리트리버를 사용한 검색 증강 생성

컨텐츠 정보

- 조회 1,729

본문

엔비디아는 1993년 세 명의 칩 설계자(CEO가 된 젠슨 황 포함)가 모여 설립한 기업이다. 1997년 고성능 3D 그래픽 프로세서를 성공적으로 출시했고, 2년 뒤에는 GPU를 발명해 컴퓨터 그래픽, 특히 비디오 게임에 엄청난 변화를 몰고 왔다. 2006년에는 CUDA(Compute Unified Device Architecture)를 선보였고 이를 통해 비디오 게임을 넘어 과학 연구와 범용 컴퓨팅 시장까지 영역을 넓혔다. 2012년에는 파이썬에서 호출할 수 있는 특수 CUDA 라이브러리(cuDNN)를 통해 GPU를 신경망에 적용했으며, 이것이 나중에는 LLM(Large Language Model) 지원까지 확대됐다.

2025년 엔비디아는 개발자를 위한 다른 여러 제품과 함께 엔비디아 NIM, 엔비디아 니모(NeMo), 엔비디아 RAG 블루프린트(Nvidia RAG Blueprint)를 포함한 엔터프라이즈 AI 소프트웨어 제품군을 대거 들고나왔다. 이들 제품은 함께 작동하면서 원시 문서를 가져오고 벡터 인덱싱된 지식 기반을 생성하고 이 지식 기반의 내용을 알고 추론할 수 있는 AI와 대화할 수 있게 해준다. 물론 이런 프로그램은 모두 엔비디아 GPU를 최대한 활용한다.

엔비디아 NIM은 기업이 어디에서나 엔비디아 GPU에서 AI 모델을 실행할 수 있게 해주는 가속 추론 마이크로서비스 모음이다. NIM에 액세스하려면 일반적으로 엔비디아 AI 엔터프라이즈(Nvidia AI Enterprise) 제품군을 구독해야 하며, 이 경우 GPU당 연간 약 4,500달러의 비용이 들지만, H200과 같은 일부 서버급 GPU에는 에센셜(Essentials) 등급의 제품군이 3~5년간 무료로 제공된다.

엔비디아 니모는 LLM, 비전 언어 모델(vision language models, VLM), 검색 모델, 비디오 모델, 음성 AI를 포함한 맞춤 생성형 AI 개발을 위한 엔드 투 엔드 플랫폼이다. 니모 플랫폼에 속하는 니모 리트리버(NeMo Retriever)는 데이터 추출 및 정보 검색 파이프라인을 구축하기 위한 모델을 제공하며, 이를 통해 원시 문서에서 표와 같은 정형 데이터, PDF와 같은 비정형 데이터를 추출할 수 있다.

엔비디아 RAG 블루프린트는 엔비디아 NIM과 GPU 가속 구성요소를 사용하는 검색 증강 생성(retrieval-augmented generation, RAG) 솔루션을 설정하는 방법을 보여주는 참조 예제로, 개발자는 이를 통해 엔비디아 NIM 서비스를 사용해 RAG 솔루션을 설정하는 작업을 빠르게 시작할 수 있다. 엔비디아 AI-Q 리서치 어시스턴트 블루프린트(Nvidia AI-Q Research Assistant Blueprint)는 RAG 블루프린트를 더 확장해서 심화 연구를 수행하고 보고서를 생성한다.

엔비디아 AI 엔터프라이즈

엔비디아 AI 엔터프라이즈는 애플리케이션과 인프라, 두 가지 유형의 소프트웨어로 구성된다. 애플리케이션 소프트웨어는 AI 에이전트와 생성형 AI, 기타 AI 워크플로우를 구축하는 데 사용되며 인프라 소프트웨어에는 엔비디아 GPU와 네트워킹 드라이버, 쿠버네티스 오퍼레이터가 포함된다.

엔비디아 NIM

엔비디아 NIM은 사전 학습된 모델과 맞춤형 AI 모델을 위한 GPU 가속 추론 마이크로서비스를 셀프 호스팅할 수 있는 컨테이너를 제공한다. NIM 컨테이너는 엔비디아 GPU에서 AI 기반 모델의 AI 추론 성능을 향상시킨다.

엔비디아 니모

니모 툴과 마이크로서비스는 엔비디아 API 카탈로그에 있는 AI 모델을 맞춤설정하고 적용할 수 있게 해준다. 엔비디아 측은 니모를 활용해 데이터 플라이휠을 만들어 선별된 AI와 사용자 피드백을 기반으로 AI 에이전트를 지속적으로 최적화하는 방법을 강조한다. 또한 니모의 가드레일과 검색 증강 생성은 모델 배포에 도움이 된다.

엔비디아 니모 리트리버

엔비디아에 따르면 니모 리트리버 마이크로서비스는 멀티모달 문서 추출과 실시간 검색을 가속화해서 RAG 비용을 낮추고 정확도를 높인다. 니모 리트리버는 다국어 및 교차 언어 검색을 지원하며 데이터 플랫폼의 저장, 성능, 적응력을 최적화한다고 한다.

Nvidia

엔비디아 AI 블루프린트

엔비디아 AI 블루프린트는 엔비디아 NIM을 활용해서 혁신적인 솔루션을 구축하는 방법을 보여주는 참조 예제다. 잠시 후에 살펴볼 RAG 주피터 노트북을 포함해 18개의 블루프린트가 제공된다.

엔비디아 브레브

엔비디아 브레브(Nvidia Brev)는 클라우드 GPU 개발 플랫폼으로, 클라우드상의 VM에서 머신러닝 모델을 실행, 구축, 학습, 배포할 수 있게 해준다. 런처블(Launchable)은 소프트웨어를 간편히 공유하는 방법이다.

엔비디아 AI-Q 블루프린트 RAG 및 리서치 어시스턴트 참조 예제

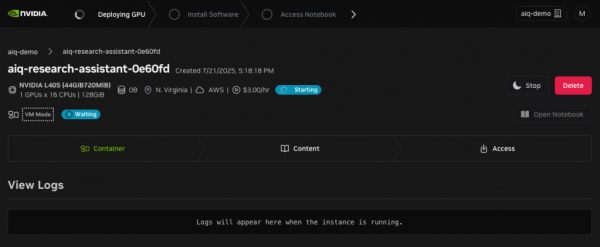

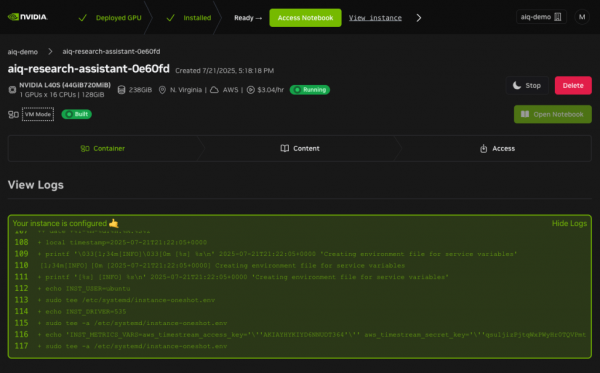

필자는 AWS에서 실행되는 브레브 런처블을 사용해서 AI-Q 블루프린트 참조 예제를 테스트했다.

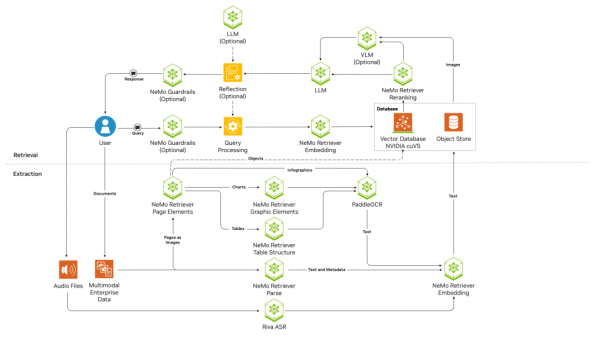

엔비디아 RAG 블루프린트(아래 그림 참조)는 기반 검색 증강 생성 파이프라인의 참조 솔루션 역할을 한다. 잘 알려진 바와 같이 RAG는 LLM이 학습 시 포함되지 않은 지식을 수용하고 관련된 사실에 집중할 수 있도록 돕는 패턴으로, 여기서는 사용자가 기업 내 코퍼스를 질의할 수 있도록 설계됐다.

엔비디아 RAG 블루프린트는 예상보다 다소 복잡한데, 이는 부분적으로 텍스트, 음성, 그래픽, 서식 있는 페이지(PDF)를 포함한 다양한 입력 형식을 처리하려고 하기 때문이다. 관련성 목록을 좁혀주는 순위 재지정, 그래픽에서 텍스트를 추출하는 OCR, 그리고 질의 기반 탈옥이나 특정 유형의 환각을 방지하기 위한 보호 장치와 같은 정밀한 기능이 포함돼 있다.

엔비디아 RAG 블루프린트 아키텍처 다이어그램. 니모 리트리버 구성요소, LLM, OCR 구성요소, 객체 저장소, 벡터 데이터베이스가 흐름에 포함돼 있다. 질의 처리 블록은 랭체인(LangChain) 프레임워크를 기반으로 한다.

엔비디아 RAG 블루프린트 아키텍처 다이어그램. 니모 리트리버 구성요소, LLM, OCR 구성요소, 객체 저장소, 벡터 데이터베이스가 흐름에 포함돼 있다. 질의 처리 블록은 랭체인(LangChain) 프레임워크를 기반으로 한다.Nvidia

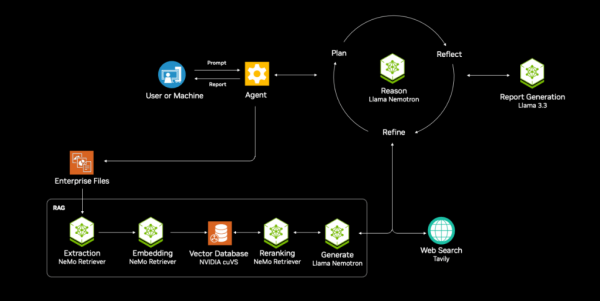

엔비디아 AI-Q 리서치 어시스턴트 블루프린트(아래 그림 참조)는 RAG 블루프린트와 LLM에 의존해 결과의 관련성을 검증한다. 최종 보고서가 생성되기 전에 발생하는 추론 사이클을 볼 수 있다.

AI-Q 리서치 어시스턴트는 RAG 기능 외에도 보고서 계획을 수립하고 데이터 소스에서 답변을 검색하고 보고서를 작성하고 보고서에서 누락된 부분을 반영해 추가 질의를 수행하고 소스 목록과 함께 보고서를 완성한다. 라마 모델은 RAG 결과 생성, 결과에 대한 추론, 그리고 보고서 생성에 사용된다.

AI-Q 리서치 어시스턴트는 RAG 기능 외에도 보고서 계획을 수립하고 데이터 소스에서 답변을 검색하고 보고서를 작성하고 보고서에서 누락된 부분을 반영해 추가 질의를 수행하고 소스 목록과 함께 보고서를 완성한다. 라마 모델은 RAG 결과 생성, 결과에 대한 추론, 그리고 보고서 생성에 사용된다.Nvidia

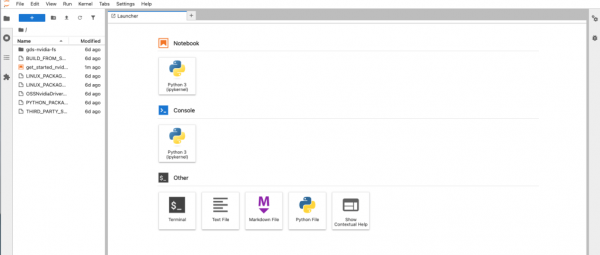

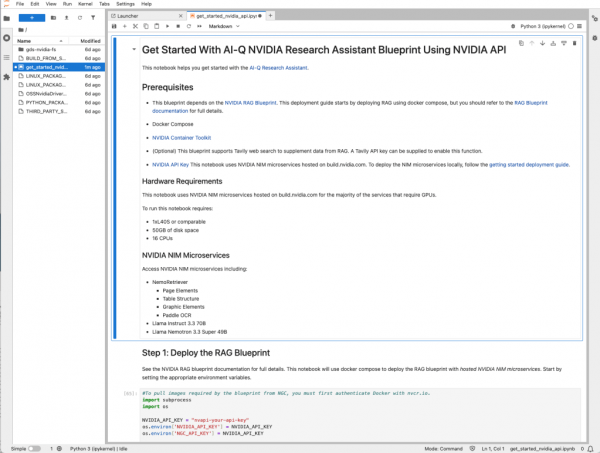

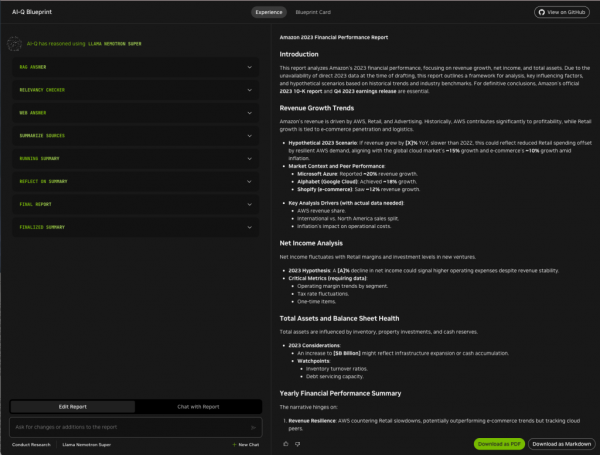

아래 스크린샷은 AI-Q 리서치 어시스턴트 블루프린트를 실행하는 화면이다.

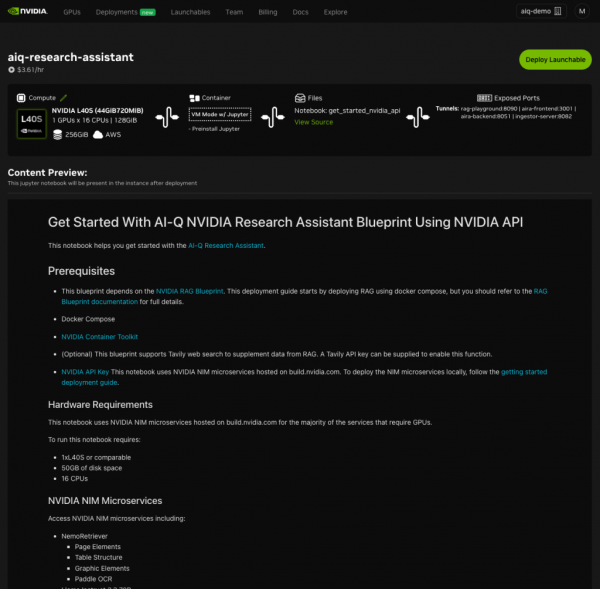

엔비디아 AI-Q 리서치 어시스턴트 블루프린트 시작 페이지. 맨 위의 막대는 전체적인 시스템 다이어그램을 보여주며 아래 텍스트는 인스턴스에 표시되는 주피터 노트북의 미리보기를 보여준다. AI-Q 리서치 어시스턴트는 위에 몇 개 나와 있는 엔비디아 RAG 블루프린트에 기반한다.

엔비디아 AI-Q 리서치 어시스턴트 블루프린트 시작 페이지. 맨 위의 막대는 전체적인 시스템 다이어그램을 보여주며 아래 텍스트는 인스턴스에 표시되는 주피터 노트북의 미리보기를 보여준다. AI-Q 리서치 어시스턴트는 위에 몇 개 나와 있는 엔비디아 RAG 블루프린트에 기반한다.Foundry

Foundry

RAG를 가미한 AI 기반 연구

PDF 형식의 재무 보고서를 처리하고 이를 기반으로 사용자 질의에 대한 보고서를 생성하는 엔비디아 AI-Q 리서치 어시스턴트 블루프린트의 성능은 필자가 기대한 이상이었다. 놀라웠던 점 중 하나는 라마 기반 모델의 성능이었다. 별도로 수행한 Llama 모델의 단순 RAG 설계 테스트에서는 결과가 그다지 좋지 않았음을 감안하면 계획-성찰-개선 아키텍처가 큰 도움이 됐다는 결론을 내릴 수밖에 없다.

원래 이 시스템에 대한 테스트는 하루 정도면 끝날 것이라고 예상했지만 실제로는 약 일주일 반이 걸렸다. 첫 번째 문제는 문서의 오류였고, 두 번째 문제는 백엔드 프로세스의 오류였던 것으로 확인됐다. 엔비디아가 두 가지 문제를 모두 해결한다고 확답한 만큼 여러분은 아마 이러한 문제를 겪지 않을 것이다.

결론

PDF 형식의 재무 보고서를 처리하고 이를 기반으로 사용자 질의에 대한 보고서를 생성하는 엔비디아 AI-Q 리서치 어시스턴트 블루프린트의 성능은 필자가 기대한 이상이었다. 별도로 수행한 Llama 모델의 단순 RAG 설계 테스트에서는 결과가 그다지 좋지 않았음을 감안하면 계획-성찰-개선 아키텍처의 성공적인 구현으로 평가할 만하다.

장점

- 온프레미스 또는 클라우드에서 실행 가능한 신뢰할 수 있는 심층 연구 어시스턴트를 만들 수 있음

- 모델이 보고서를 반복적으로 개선

- 니모 리트리버가 PDF를 빠르게 처리

- 오픈소스 블루프린트는 자체 AI 연구 애플리케이션에 맞게 수정 가능

단점

- 테스트한 버전에는 여전히 몇 가지 버그가 있었음(지금은 수정되었을 것으로 추정)

- 엔비디아 GPU에 종속

비용

가격은 공인 엔비디아 파트너를 통해 확인할 수 있다.

플랫폼

도커 컴포즈(Docker Compose) 또는 엔비디아 AI 워크벤치(Nvidia AI Workbench), 충분한 메모리를 갖춘 서버급 엔비디아 GPU. 엔비디아 API를 사용해 클라우드에서 실행하거나 온프레미스 환경에서 컨테이너로 실행할 수 있다.

dl-itworldkorea@foundryco.com

관련자료

-

링크

-

이전

-

다음