“테라비트 시대로 향하는 AI 네트워킹” 이더넷·인피니밴드·옴니패스 삼파전

컨텐츠 정보

- 조회 1,742

본문

네트워킹 기술의 가장 기본적인 단위는 상호 연결(Interconnect) 기술이다. 이는 한 장비가 다른 장비와 표준화된 방식으로 연결될 수 있도록 해주는 프로토콜과 프레임워크를 의미한다. 현대 데이터센터에서는 AI의 영향으로 이 상호 연결 기술이 그 어느 때보다도 큰 부담을 받고 있다.

수조 개 파라미터를 학습할 수 있는 대규모 AI 시스템을 구축하려는 경쟁이 전례 없는 병목현상을 낳고 있다. 수천 대의 가속기 사이에서 데이터를 빠르게 이동시키는 일이 어려워진 것이다. 효율적인 상호 연결 기술 없이는 최신 AI 모델이라도 제 기능을 못하며, 데이터 이동 지연은 생성형 AI를 구동하는 LLM 학습에 필수적인 병렬처리 성능을 크게 저하시킨다.

AI 네트워킹의 과제

AI 수요는 상호 연결 기술의 형태 자체를 바꾸고 있다. 범용 컴퓨팅을 염두에 두고 설계된 기존 네트워크는 AI 워크로드의 독특한 요구사항을 제대로 처리하지 못한다. AI 학습과 추론은 기존 데이터센터 애플리케이션과는 전혀 다른 네트워킹 과제를 만들어낸다. 현대 AI 시스템의 규모와 통신 방식은 상호 연결 기술을 원래 설계 범위를 훨씬 넘어서는 수준까지 몰아붙이고 있다.

AI가 기존 워크로드와 다른 점은 다음과 같다.

- 통신 방식. 기존 애플리케이션은 클라이언트/서버 방식이지만, AI는 모든 GPU가 동시에 서로 통신하는 올투올(all-to-all) 방식을 사용한다.

- 대역폭 확장. AI 모델 파라미터를 2배로 늘리면 수천 대 가속기 간의 그래디언트 동기화 때문에 네트워크 트래픽은 4배로 증가할 수 있다.

- 지연시간 민감도. AI 학습 동기화에는 µs(100만분의 1초) 이하의 응답 속도가 요구되며, 기존 애플리케이션의 ms 허용치보다 훨씬 엄격하다.

- 트래픽 양. 대규모 학습 클러스터는 기존 HPC의 피크 트래픽을 훨씬 초과하는 수준의 지속적인 데이터 흐름을 만들어낸다.

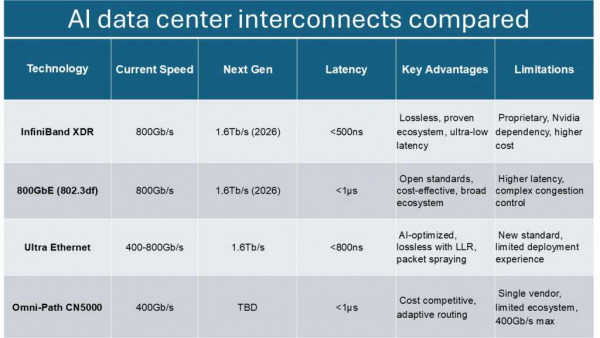

2025년 기준으로 데이터센터 상호 연결 기술은 실질적으로 이더넷, 인피니밴드, 옴니패스 세 가지가 핵심이다.

AI 최적화로 테라비트 시대 향하는 이더넷

수십 년 된 표준인 이더넷은 호환성과 비용 효율성, 확장성 덕분에 오랫동안 엔터프라이즈 데이터센터를 지배해 왔다. 그러나 AI 환경에서는 순정 이더넷이 높은 트래픽 상황에서 지연시간과 패킷 손실이 심해 한계를 드러낸다.

최근 여러 변화가 이런 이더넷을 AI 요구에 맞게 발전시키고 있다. IEEE 802.3df-2024: 2024년 2월에 확정된 IEEE 802.3df-2024 표준은 AI 데이터센터 네트워킹에 중대한 전환점을 만들었다. 이 표준은 800기가비트 이더넷 사양을 제공하며 차세대 AI 클러스터의 기반을 마련한다. 800GbE 단일 포트로부터 2×400GbE, 4×200GbE, 8×100GbE 등 다양한 구성으로 활용할 수 있는 8레인 병렬 구조를 제공한다. 기존 100Gb/s 방식과도 하위 호환성을 유지해, 기존 인프라 투자를 보호하면서도 원활한 전환 경로를 지원한다.

UEC 1.0도 있다. 울트라 이더넷 컨소시엄(Ultra Ethernet Consortium)은 AI 워크로드를 위해 이더넷을 최적화하려는 업계 최대 규모의 시도이다. 이 컨소시엄은 2025년에 UEC 1.0 사양을 공개하며 AI 네트워킹의 중대한 이정표를 세웠다. 이 사양은 최신 RDMA 구현, 향상된 전송 프로토콜, 고급 혼잡 제어 메커니즘을 포함해 기존 손실 없는 네트워크의 필요성을 없앴다. UEC 1.0은 스위치 수준에서 패킷 스프레이(Packet Spraying)를 실행하고, NIC에서 재정렬함으로써 기존에는 독점 시스템에서만 가능했던 기능을 제공한다.

이 사양에는 전통적인 우선순위 흐름 제어(Priority Flow Control, PFC) 없이도 손실 없는 전송이 가능한 LLR(Link Level Retry) 기능도 포함돼 있다. LLR은 링크 계층에서 패킷 손실을 감지하고 로컬 재전송함으로써 상위 계층에서 발생하는 비용 높은 복구 과정을 방지한다. 또한 헤더 압축을 통한 프로토콜 오버헤드 축소 기능인 PRI(Packet Rate Improvement), 네트워크 혼잡을 실시간으로 파악할 수 있는 네트워크 프로브 기능도 제공된다.

인피니밴드, 아키텍처 장점 그대로 800Gb/s로 확장

인피니밴드는 1990년대 후반 고성능 인터커넥트 기술로 등장했다. 데이터센터에서 서버 간 통신을 위해 특별히 설계됐으며, 로컬 네트워크에서 발전한 이더넷과 달리 클러스터 컴퓨팅의 까다로운 요구를 충족시키기 위해 탄생한 기술이다. 이 기술은 하드웨어 기반 흐름 제어와 전용 네트워크 어댑터를 통해 손실 없는 초저지연 통신을 제공한다.

인피니밴드의 핵심 장점은 크레딧 기반 흐름 제어에 있다. 패킷 기반 접근 방식을 사용하는 이더넷과 달리, 인피니밴드는 수신 버퍼에 여유 공간이 있는 경우에만 전송을 시작해 패킷 손실을 사전에 방지한다. 이를 통해 대규모 AI 학습 작업 중 패킷 손실로 인한 연쇄 실패를 원천 차단할 수 있다.

인피니밴드는 XDR(eXtended Data Rate)로 진화하며 기존 아키텍처의 강점을 유지한 채 이더넷과 동일한 대역폭 수준까지 확장됐다. 2023년 10월 발표된 IBTA 볼륨 1 릴리즈 1.7 사양은 포트당 800Gb/s, 스위치 간 최대 1.6Tb/s 연결을 정의하며, 이를 위해 레인당 200Gb/s 직렬 디서리얼라이저(SerDes) 기술을 사용한다. XDR 스위치는 500ns 미만의 지연시간을 목표로 하며, 최대 50만 개 엔드포인트를 거의 선형적으로 확장할 수 있다.

옴니패스, AI 네트워킹 시장에서 비용 경쟁력 무기로 부활

옴니패스는 2010년대 중반 인텔이 엔비디아의 인피니밴드 독점에 도전하고자 개발한 HPC용 상호 연결 기술이다. 옴니패스는 적응형 라우팅, 통합 패브릭 관리, 경쟁력 있는 성능을 특징으로 했지만, 인텔이 2019년 프로세서 중심 전략으로 방향을 틀면서 개발을 중단했다.

그러나 옴니패스는 2020년 인텔의 기존 엔지니어링팀이 코넬리스 네트워크(Cornelis Networks)로 분사하면서 다시 생명을 얻었다. 코넬리스는 CN5000 시리즈를 통해 옴니패스를 부활시켰으며, 400Gb/s AI 네트워크 구축을 겨냥해 엔비디아 솔루션 대비 비용 경쟁력을 내세우고 있다.

코넬리스는 절대 성능보다 비용 대비 성능 최적화가 중요한 가격 민감형 AI 구축 환경을 주요 대상으로 한다. 그러나 이 기술은 폭넓은 솔루션 업체 생태계와 정교한 소프트웨어 최적화 기반의 기존 상호 연결 기술과 비교해 불리한 위치에 있다. 코넬리스는 차세대 CN6000 시리즈에서 옴니패스 네이티브 모드와 이더넷 호환 모드를 동시에 지원하는 이중 모드 기능을 제공하겠다고 예고했다.

AI가 산업을 재편하는 지금, 이더넷, 인피니밴드, 옴니패스 같은 상호 연결 기술은 단순한 데이터 통로를 넘어 지능형 패브릭으로 진화하고 있다.

인피니밴드가 성능 측면에서는 앞서 있지만, 이더넷은 개방성과 호환성을 무기로 하고 있고, 옴니패스는 재도전을 통해 보다 개방적인 상호 연결 시장을 예고하고 있다. 하이퍼스케일러는 혁신과 경제성을 균형 있게 추구하는 하이브리드 전략을 채택하고 있다. 이 신경망 혁명의 시대에 진정한 지능은 노드 간 연결 그 자체에 있을지도 모른다.

관련자료

-

링크

-

이전

-

다음