머신러닝을 활용한 어노테이션 품질 개선 방법

컨텐츠 정보

- 조회 1,578

본문

데이터 과학 팀이나 머신러닝 팀을 괴롭히는 숨겨진 생산성 저해 요인은 바로 어노테이션 오류다. 최근 애플이 프로덕션 머신러닝(ML) 애플리케이션을 분석한 결과 검색 관련 작업 전반에서 어노테이션 오류율은 평균 10%로 나타났다. 컴퓨터 비전 분야의 대표적인 벤치마크인 이미지넷(ImageNet) 역시 2024년 MIT CSAIL 조사에서 오류율이 6%에 이르는 것으로 밝혀졌다. 이러한 오류가 몇 년 동안 모델 순위를 왜곡시켜왔다.

높은 오류율은 단순히 정확도 지표에만 영향을 미치는 것이 아니다. 컴퓨터 비전 팀은 데이터 준비와 어노테이션에 너무 많은 시간을 소비하게 되고, 품질 문제로 인해 엔지니어가 모델 구축보다 오류 수정에 데 더 많은 시간을 소비하는 개발 병목 현상이 발생한다. 수동 품질 관리를 사용하는 경우 프로덕션에 사용할 수 있는 수준의 데이터 집합을 얻기까지 일반적으로 5~7회의 검토 사이클을 거치는데 각 사이클마다 어노테이터, 도메인 전문가, 엔지니어 간의 조율이 필요하다.

재무적으로 미치는 영향은 1x10x100 규칙을 따른다. 즉, 제품을 만드는 과정에서 어노테이션 오류를 수정할 때 1달러의 비용이 든다면 테스트 단계에서는 10달러가 들고 배포 이후에는 운영 중단과 평판 손상까지 고려할 때 100달러가 소비된다.

현재의 어노테이션 툴이 기대에 미치지 못하는 이유

기존 어노테이션 플랫폼에서는 근본적인 이해의 충돌로 인해 품질 관리가 핵심 역량이 아닌 부차적 요소가 될 수밖에 없다. 엔터프라이즈 솔루션의 비즈니스 모델은 일반적으로 볼륨에 인센티브를 부여한다. 즉, 고성능 다운스트림 모델을 제공하는 데서 수익을 얻지 않고 어노테이션당 비용을 청구하는 방식으로 수익을 얻는다. 이 같은 방식은 오류 방지를 위해 노력할 동기는 거의 부여하지 않으면서(비용 청구가 가능한 작업이 줄어드는 결과를 초래하므로), 끊임없이 증가하는 데이터에 어노테이션을 추가하도록 유도한다. 이들은 블랙박스 방식으로 운영하면서 QA 프로세스에 대해서는 최소한의 시야만 제공하고, 요구하는 계약 규모도 5만 달러 이상이다. 결국 툴을 사용하는 팀 입장에서는 어노테이션 품질을 체계적으로 이해하거나 개선할 방법이 없다.

컴퓨터 비전 어노테이션 툴(CVAT), 라벨 스튜디오(Label Studio)와 같은 오픈소스 대안은 라벨링 워크플로우에 초점을 두기 때문에 프로덕션 시스템에 필요한 정교한 오류 탐지 측면에서는 떨어진다. 여러 어노테이터가 같은 샘플을 검토하는 기본적인 합의 메커니즘을 제공하지만 실제로 검토가 필요한 샘플의 우선 처리, 또는 오류 패턴에 대한 체계적인 분석은 제공하지 않는다.

이러한 문제는 수치로 명확히 드러난다. 현재 기업의 45%가 4개 이상의 어노테이션 툴을 동시에 사용한다. 이렇게 부분적인 해결책을 얼기설기 연결해 사용하고 있지만 품질 공백은 여전히 발생한다. 결과적으로 초기 어노테이션, 광범위한 수동 QA, 수정, 재검증을 거치는 값비싸고 복잡한 프로세스가 반복된다. 기반 툴이 품질 문제를 체계적으로 식별하고 예방할 만큼의 지능을 갖추지 못한 상황에서 각 단계가 수행될 때마다 개발 타임라인은 몇 주씩 늦춰진다.

현대의 ML 개발에는 단순히 라벨링 워크플로우를 관리하는 것이 아니라 데이터를 이해할 수 있는 어노테이션 플랫폼이 필요하다. 이 이해가 없으면 팀은 모델 혁신에 투입해야 할 엔지니어링 리소스를 소모하고, 확장성이 떨어지는 사후 대응적 품질 관리 사이클에 갇히게 된다.

데이터 중심 어노테이션 솔루션

복셀51(Voxel51)의 주력 제품인 피프티원(FiftyOne)은 접근 방식을 근본적으로 바꿔서 어노테이션 품질 관리를 라벨링 워크플로우 문제가 아닌 데이터 이해 문제로 접근한다. 라벨 생성에 초점을 두는 기존 제품과 달리 실제로 어노테이션에 주의가 필요한 데이터가 무엇인지, 그리고 오류가 발생할 가능성이 가장 높은 곳이 어디인지 파악함으로써 팀이 더 스마트하게 일할 수 있게 해준다.

이러한 데이터 중심 접근 방식은 사후 대응적 품질 관리에서 선제적 데이터 인텔리전스로의 패러다임 전환을 의미한다. 전체 데이터 집합을 주먹구구식으로 라벨링하거나 무작위 샘플을 검토하는 대신 ML 기반 분석을 사용해 영향력이 큰 데이터에 높은 우선순위를 부여하고 어노테이션 오류를 자동으로 탐지하고 사람의 전문성을 그 전문성이 가장 필요한 곳에 집중시킨다.

피프티원은 머신러닝을 활용해 구체적이고 조치 가능한 품질 문제를 파악한다. 이 방법론은 어노테이션 오류가 무작위로 발생하는 것이 아님을 인지한다. 오류는 시각적 복잡성, 모호한 경계 사례, 시스템적 편향성에 의해 발생하며, 알고리즘적으로 탐지와 교정이 가능하다.

이 인텔리전스는 어노테이션을 비용 센터에서 전략적 역량으로 바꿔준다. 팀은 오류율 10%를 불가피한 것으로 받아들이는 것이 아니라 오류율을 체계적으로 낮추고, 프로덕션 수준의 품질을 갖춘 데이터 집합을 얻는 데 필요한 시간과 비용을 줄일 수 있다. 피프티원은 오픈소스 커뮤니티에서 300만 번 이상 설치됐으며 마이크로소프트, 구글, 보쉬, 포드, 레이시온, 버크셔 그레이를 비롯한 많은 기업에서도 사용되고 있다.

mistakenness 점수를 사용한 자동 오류 탐지

피프티원의 compute_mistakenness() 기능은 참값(ground truth) 라벨과 모델 예측 간의 불일치를 분석해 잠재적인 어노테이션 오류를 식별한다. 이 ML 기반 접근 방식은 발생 가능성과 영향에 따라 오류를 순위화해서 기존의 몇 주가 걸렸던 수동 검토 작업을 몇 시간 정도의 타겟팅된 교정 작업으로 바꿔준다.

import fiftyone.brain as fob# Automatically detect likely annotation errorsfob.compute_mistakenness(dataset, "predictions", label_field="ground_truth")

이 시스템은 다음과 같은 여러 오류 지표를 생성한다.

- mistakenness: 라벨이 부정확할 가능성(0-1 스케일)

- possible_missing: 일치되는 참값이 없는 고신뢰도 예측

- possible_spurious: 부정확할 가능성이 높은, 일치되지 않은 참값 객체

from fiftyone import ViewField as F# Show most likely annotation mistakes firstmistake_view = dataset.sort_by("mistakenness", reverse=True)# Find highly suspicious labels (>95% error likelihood)high_errors_view = dataset.filter_labels("ground_truth", F("mistakenness") > 0.95)# Identify samples with missing annotationsmissing_objects_view = dataset.match(F("possible_missing") > 0)피프티원의 인터랙티브 인터페이스는 식별된 오류를 즉시 시각적으로 검증할 수 있게 해준다. 팀은 탐지된 문제가 실제 어노테이션 실수인지 모델의 한계인지를 신속하게 확인해서 무작위 샘플 검토가 아닌 실질적인 문제에 인간의 전문성을 집중시킬 수 있다.

이 같은 지능적인 우선순위화는 무작위 샘플링 방식에 비해 정확한 라벨로 수렴되는 속도가 훨씬 더 빠르다. 세이플리유(SafelyYou)와 같은 고객은 수동 검증을 위해 전송되는 이미지가 77% 감소했다고 보고했다.

패치 임베딩 기반의 패턴 발견

피프티원의 패치 임베딩 시각화는 전통적인 지표로는 보이지 않는 품질 문제를 드러낸다. 이 플랫폼의 유사성 분석은 샘플을 의미 공간에 투영해서 일관되지 않은 어노테이션이 있는 유사한 이미지의 클러스터를 보여준다.

즉, 임베딩은 같은 방식으로 라벨이 돼야 하지만 그렇지 않은 유사 객체 그룹을 찾는다(일관성 기반 오류 탐지).

import fiftyone as foimport fiftyone.brain as fobimport fiftyone.zoo as foz# Path to BDD100k dataset filessource_dir = "/path/to/bdd100k-dataset"# Load dataset dataset = foz.load_zoo_dataset("bdd100k", split="validation", source_dir=source_dir)# Compute patch embeddings using pre-trained modelmodel = foz.load_zoo_model("mobilenet-v2-imagenet-torch")gt_patches = dataset.to_patches("detections")gt_patches.compute_patch_embeddings( model=model, patches_field='detections', embeddings_field='patch_embeddings',)# Generate embedding visualizationresults = fob.compute_visualization( gt_patches, embeddings='patch_embeddings', brain_key="img_viz")# Launch interactive visualizationsession = fo.launch_app(gt_patches)클러스터를 사용하면 통계적 품질 지표로는 볼 수 없는 벤더별 어노테이션 오류를 식별할 수 있는데, 이러한 오류는 잘못 분류된 샘플의 의미적 유사성을 시각화해야만 명확하게 드러난다.

품질 관리를 위한 유사성 검색

문제가 있는 어노테이션 하나를 찾았다면 유사성 검색이라는 강력한 툴을 사용해 관련된 모든 오류를 찾을 수 있다. 잘못 라벨링된 샘플을 클릭하면 가장 유사한 이미지를 즉시 검색해서 동일한 체계적 라벨링 문제가 있는지 여부를 확인할 수 있다.

“비슷한 항목 더 찾기”는 원래 힘든 수작업이지만 피프티원의 유사성 검색을 사용하면 즉각적인 발견으로 바뀐다. 데이터 집합을 한 번 인덱싱하면 포인트 앤 클릭이나 프로그래밍 쿼리를 통해 시각적으로 유사한 샘플을 즉시 검색할 수 있다.

import fiftyone as foimport fiftyone.brain as fobimport fiftyone.zoo as foz# Load datasetdataset = foz.load_zoo_dataset("quickstart")# Index images by similarityfob.compute_similarity( dataset, model="clip-vit-base32-torch", brain_key="img_sim")# Sort by most likely to contain annotation mistakesmistake_view = dataset.sort_by("mistakenness", reverse=True)# Query the first sample and find 10 most similar imagesquery_id = mistake_view.take(1).first().idsimilar_view = dataset.sort_by_similarity(query_id, k=10, brain_key="img_sim")# Launch App to view similar samples and for point-and-click similarity searchsession = fo.launch_app(dataset)주요 기능에는 앱 인터페이스를 통한 빠른 시각적 검색, 탐지 패치를 위한 객체 수준 유사성 인덱싱, 그리고 프로덕션을 위해 sklearn에서 Qdrant, Pinecone 또는 기타 벡터 데이터베이스로 전환할 수 있는 확장 가능한 백엔드가 포함된다.

문제가 있는 샘플은 어노테이터에 전송되기 전에 제거

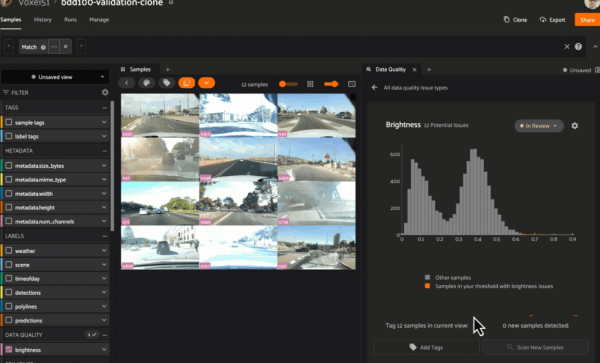

피프티원의 데이터 품질 워크플로우는 데이터 집합에서 어노테이션 실수로 이어지기 쉬운 시각적 문제를 스캔한다. 내장된 분석기는 어노테이터가 비일관적으로 라벨링하는 경우가 많은 문제 샘플(지나치게 밝거나 어두운 이미지, 과도한 블러, 극단적인 종횡비, 거의 동일한 중복 등)을 탐지한다.

데이터 품질 워크플로우를 사용한 어노테이션 오류 방지

- 밝기/블러 탐지: 어노테이터가 라벨을 막연히 추정해야 하는 저품질 이미지 식별

- 거의 동일한 중복 찾기: 시각적으로 동일한 샘플 사이에서 비일관적인 어노테이션 파악

- 극단적인 종횡비: 어노테이터에게 객체 비율에 대한 혼란을 주는 왜곡된 이미지에 표시

- 인터랙티브 임계값: 민감도를 조정해서 품질이 저하되는 경계 사례를 탐색

버크셔 그레이와 같은 기업은 태깅 시스템을 사용해 문제 샘플을 격리함으로써 잘못된 어노테이션으로 인해 모델 학습이 오염되는 상황을 방지하는 방법으로 조사 속도를 3배 높였다. 이렇게 하면 사후 대응적인 디버깅이었던 품질 관리가 선제적인 예방으로 전환된다.

기존 어노테이션 툴 및 파이프라인과 함께 작동

피프티원을 사용한다고 해서 기존 어노테이션 인프라를 버려야 하는 것은 아니다. 피프티원은 CVAT, 라벨박스, 라벨 스튜디오, V7 다윈을 포함한 다른 플랫폼과 매끄럽게 통합이 가능하다. 이 플랫폼의 annotate() API는 출처 추적 정보를 그대로 유지하면서 이와 같은 서비스에 직접 샘플을 업로드한다. 교정 후에는 load_annotations()가 업데이트된 라벨을 검증을 위해 피프티원으로 다시 가져온다.

이 통합은 플랫폼 전반에 걸쳐 확장된다. 피프티원은 파이토치, 텐서플로우, 허깅 페이스와 기본적으로 함께 작동하면서 기존 ML 파이프라인 내에서 품질 평가를 가능하게 해준다. 또한 피프티원의 플러그인 아키텍처를 통해 특정 워크플로우를 위한 맞춤형 기능을 빠르게 개발할 수 있다.

피프티원의 데이터 중심 접근 방식은 품질 평가 시간을 80% 줄이는 자동화된 오류 탐지를 제공하고, 모델 정확도를 15~30% 개선하며, 운영 효율성을 최대 50% 높여준다. 피프티원이 기존 라벨링 플랫폼과 차별화되는 부분은 투명성과 유연성을 보장하는 오픈 코어 기반을 유지하면서도 ML 기반 분석을 통해 데이터 집합의 품질을 이해하고 개선하는 데 집중한다는 점이다.

어노테이션 품질 문제에 매몰된 엔지니어링 팀을 위한 해결책은 더 나은 라벨링 툴이 아니라 더 나은 데이터 이해에 있다. 피프티원은 수동적인 병목 지점이었던 어노테이션 품질 문제를 현대 ML 개발 요구에 따라 확장되는 자동화되고 지능적인 프로세스로 바꿔준다.

dl-itworldkorea@foundryco.com

관련자료

-

링크

-

이전

-

다음