“데이터 인프라가 AI 성공을 결정한다” 미래 AI 환경을 위한 데이터 레이크하우스 전략

컨텐츠 정보

- 조회 1,892

본문

이세돌과 알파고의 대국에 세간의 이목이 집중되었을 때만 해도 AI는 조금은 멀리 있는 신기술로 여겨졌다. 하지만 챗GPT의 등장과 함께 AI는 최첨단 기술을 다루는 기업만이 아니라 모든 기업이 쉽게 적용할 수 있는 시스템으로 인식되고 있다. 이제는 일반 사용자의 스마트폰과 PC에도 탑재되어 누구나 쉽게 접근할 수 있는 기술로 부상했다.

더구나 AI 모델 컴퓨팅 성능은 매년 4~5배씩 높아지고 있다. AI에 대한 관심과 수요가 높아지면서 관련 기술 업체도 증가하고 업체 간의 경쟁, 기반 인프라의 발전으로 AI의 성능은 점점 더 개선되고 있다. 오픈AI와 엔비디아 같은 선도업체는 2028년이면 인공일반지능(Artificial General Intelligence)의 시대가 열릴 것으로 전망하고 있으며, 이미 인간 지능을 초월하는 초인공지능 개념도 나와있는 상태이다.

이처럼 AI를 둘러싼 변화가 빠르게 전개되면서 생성형 AI를 도입하려는 기업은 더욱 고민에 빠질 수밖에 없다. 시장 경쟁에서 도태되지 않기 위해서는 생성형 AI의 가능성을 적극 활용해야 하지만, 기술 선택부터 데이터, 인프라 등 고려해야 할 요소가 많기 때문이다.

AI 도입을 추진하는 기업이 고려해야 할 사항

데이터 혁신 기업 HS효성인포메이션시스템은 AI 통합 플랫폼과 데이터 아키텍처의 중요성을 강조한다. 특히 데이터 중심의 혁신이 산업 전반으로 확대되면서 데이터 레이크하우스(Lakehouse)가 주목받고 있다. 최근 한국IDC와 CIO Korea가 주최한 ” Future Enterprise Summit & Awards”에서 효성인포메이션시스템 데이터사업팀 권동수 전문위원은 기업이 생성형 AI 도입을 추진할 때 고려해야 할 사항을 제시하고, 다양한 솔루션과 레퍼런스를 바탕으로 기업이 완벽한 디지털 혁신의 밑그림을 그리고 현실화할 수 있는 데이터 레이크하우스 전략을 소개했다.

권동수 전문위원은 기업이 생성형 AI 도입 시 고려해야 할 사항을 5가지로 요약했다. 첫 번째, 정확한 목표 파악이다. 특히, 생성형 AI는 활용 분야가 넓기 때문에 목적에 맞는 생성형 AI 구현을 우선시해야 한다. 물론, 이를 기반으로 다른 영역에 적용할 수 있는 확장성을 고려하지 않으면 매번 새로운 생성형 AI 프로젝트를 시작해야 한다.

그 다음은 기존 기술 환경과의 결합이다. 생성형 AI 기술은 현재 여러 선택지가 나와 있지만, 프로젝트 성공률이 높지 않은 실정이다. AI 기술만 바라보고 성급하게 프로젝트를 진행하기 때문이다. 권동수 전문위원은 “기업 내부의 데이터를 정확하게 이해하고 이를 연계할 수 있는 기술을 파악하고, 어떻게 연결할 것인지 정확한 지침에 따라 진행해야 한다”고 강조했다. 기술적인 측면에서는 외부 데이터를 활용할 수 있도록 온프레미스와 퍼블릭 클라우드를 결합한 하이브리드 환경에서 생성형 AI를 지원하는 것도 중요하다.

기술적인 요소만 중요한 것은 아니다. 생성형 AI 도입에 성공하려면, 비즈니스 도메인에 대한 지식이 필수적이다. 따라서 생성형 AI 파트너를 선정할 때에도 AI 기술력뿐만 아니라 기업의 비즈니스를 이해하고, 그 이해를 기반으로 기술을 지원할 수 있는 파트너를 구해야 한다.

마지막은 AI를 위한 인프라이다. 생성형 AI는 지속적인 재학습을 통해 모델을 개선해 나가야 한다. 그렇기 때문에 고성능 연산과 스토리지, 네트워크로 최적화된 AI 시스템을 구축할 수 있는 어플라이언스 기반의 AI 플랫폼이 필요하다.

AI를 위한 현대적인 인프라와 데이터 아키텍처

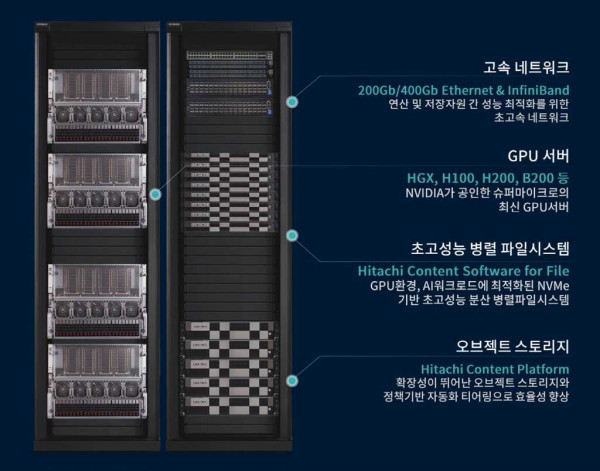

일반적인 IT 인프라와 AI를 위한 인프라의 차이점은 고속 네트워크와 GPU 서버, 병렬 파일 시스템, 그리고 오브젝트 스토리지의 4가지로 볼 수 있다.

가장 중요한 것은 고속도로처럼 대량의 데이터가 원활하게 오갈 수 있는 고성능 네트워크이다. 주로 200/400GB인피니밴드나 이더넷으로 구성한다. GPU 서버는 AI 연산에 필수적인데, 칩 기술이 빠르게 발전하고 있으므로 기술 로드맵도 신경을 써야 한다.

연산과 네트워킹 다음은 빠르고 용량이 큰 데이터 저장 인프라이다. 기존의 SAN이나 NAS의 성능은 수십 GBps가 한계인데, GPU가 처리하는 데이터는 수백 GBps에 달한다. 따라서 GPU와 고속 네트워크에 걸맞은 성능을 제공하는 저장소가 필요하며, 빠르게 증가하는 데이터를 담아낼 수 있는 확장성 높은 초고성능 병렬 파일 시스템과 오브젝트 스토리지도 필수적이다.

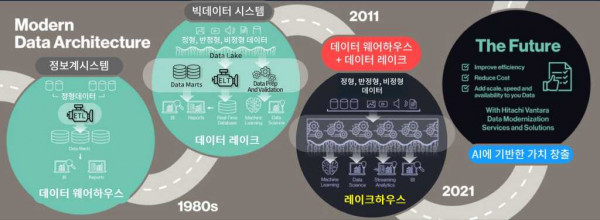

이렇게 구성한 인프라에서 데이터를 비용 효율적으로 활용할 수 있는 방안으로 주목받고 있는 것이 데이터 레이크하우스이다. 데이터 레이크하우스는 데이터 웨어하우스의 성능과 데이터 레이크의 방대한 데이터라는 두 가지 장점을 결합한 아키텍처이다.

일반적인 기업의 데이터 아키텍처는 정보계 시스템의 정형 데이터를 저장하는 데이터 웨어하우스, 그리고 비정형 데이터를 포함하는 빅데이터 시스템을 저장하는 데이터 레이크로 나뉘어져 있다. 하지만 데이터 레이크 기술이 발전하면서 데이터 레이크의 데이터를 정형 데이터처럼 활용할 수 있는 기술이 나오기 시작했다. 이런 기술을 통해 모든 데이터를 통합해 구성하는 것이 바로 데이터 레이크하우스이다.

권동수 전문위원은 “수백 GBps의 성능을 지원하면서 다양한 형태의 데이터를 통합적으로 저장할 수 있다. 데이터 레이크하우스는 AI가 원하는 바로 그 데이터 아키텍처”라고 강조했다.

“데이터 규모보다 중요한 것은 데이터 아키텍처”

권동수 전문위원은 HS효성인포메이션시스템의 경험을 기반으로 참고할 만한 AI 구축 사례도 소개했다.

국내 그룹 SI 기업인 A사는 그룹 내의 여러 회사와 부서가 사용할 수 있는 sLLM을 위한 AI/HPC 인프라를 구축했다. 슈퍼마이크로의 최신 GPU 서버와 고속 인피니밴드 네트워크, 고성능 스토리지 HCSF, 그리고 리눅스 클러스터를 위한 오픈소스 자원 관리 솔루션 슬럼(Slum) 등을 적용했다.

다양한 플랫폼이 쿠버네티스 기반의 컨테이너에서 가동되고, 100TB 용량의 데이터는 쿠버네티스 연계 기능을 제공해 볼륨 운영 최적화 및 효율화를 지원했다. 특히 고성능 네트워크를 통해 연결된 병렬 시스템은 수백 GBps의 트래픽을 처리할 수 있으며, 무제한급 확장을 지원해 데이터 공유와 GPU 자원을 여러 관계 기업과 부서가 쉽게 활용할 수 있도록 했다.

국내 AI 서비스 기업인 B사는 AI 교육 및 자사 AI 학습 모델 테스트 환경을 위한 프라이빗 클라우드 기반의 HPC 인프라를 구축했다. A사와 거의 같은 구조이지만, 데이터 용량이 600TB 규모로 훨씬 크다. AI 교육이 진행되면 쿠버네티스를 통해 필요한 자원을 생성하고 교육이 끝나면 쉽게 자원을 회수할 수 있도록 했다. 특히 기존 환경처럼 스토리지 관리와 분석, 교육을 위한 인프라를 별도로 생성하지 않고 한번에 해결할 수 있다는 것이 장점이다.

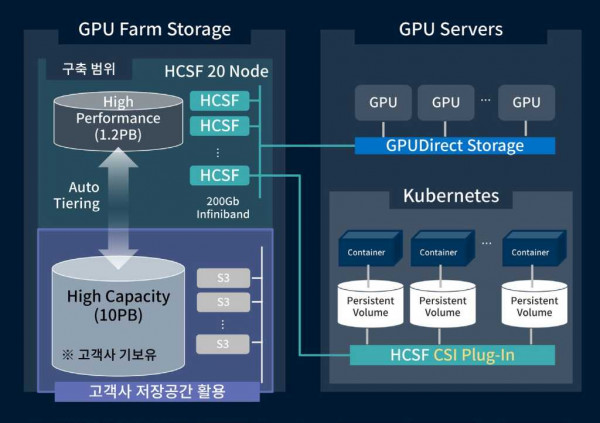

국내 연구개발 기업인 C사는 자연어 처리 알고리즘 학습 성능을 개선하기 위해 GPU 서버와 전용 스토리지를 도입했다. 특히, C사가 보유하고 있는 기존 데이터가 무려 10PB 규모였는데, 이런 규모의 데이터를 모두 고성능 스토리지에 담을 수는 없다. C사는 1.2PB 규모의 고성능 데이터 스토리지를 구축하면서 기존 S3 스토리지와의 자동 계층화를 구성해 기존 스토리지의 활용성을 확보했다.

권동수 전문위원은 “이상의 세 사례에서 보듯이 데이터 규모가 아무리 커도 AI 플랫폼은 구성 자체가 복잡하지 않다. 데이터 아키텍처만 잘 구성하면 프로젝트를 성공적으로 완료할 수 있다”고 강조했다.

AI 인프라 구축을 위한 핵심 체크포인트

AI에 대한 기업의 수요가 폭증하고 이를 지원하는 기술 업계의 움직임 또한 활발해지면서 AI 관련 기술 환경은 빠르게 진화하고 있다. 마지막으로 권동수 전문위원은 새로운 기술이 끊임없이 등장하는 환경에서 AI 인프라 구축 프로젝트를 성공적으로 완료할 수 있는 3가지 체크포인트를 제시했다.

우선, AI/HPC에 대한 요구사항을 정확하게 확인하고, 계획한 성능 안에서 원하는 모델이 구성할 수 있는지 반드시 PoC 또는 BMT를 진행해야 한다. 똑같은 알고리즘이라도 데이터 형태와 규모에 따라 성능은 달라진다. 모델은 알고리즘에 데이터를 학습시켜 만들어지기 때문이다. 두 번째는 대용량 데이터 구성에 대한 레퍼런스다. 기존 방식으로 대용량 데이터를 처리하면 성능 문제가 발생할 가능성이 있다. 데이터 처리에 병목이 생기면 GPU의 성능을 제대로 구현하지 못한다.

마지막은 기술력이다. AI 환경은 다양한 솔루션이 연계되어 있다. 특히 새로운 모델을 신속하게 구현하기 위해서는 제대로 된 기술 지원이 필수적이다. 권동수 전문위원은 “결국, 자체 국내 기술인력이 있는 업체와 연계해야만 AI 프로젝트를 성공적으로 완료할 수 있다”고 덧붙였다.

dl-itworldkorea@foundryco.com

관련자료

-

링크

-

이전

-

다음